ディープラーニングの領域で特に時間的なデータや順序が重要なタスクに用いられるのが、RNN(Recurrent Neural Networks、再帰型ニューラルネットワーク)です。RNNは、過去の情報を記憶し、それを次のステップの入力に利用する能力を持っています。

本記事ではRNNについて基本概念から応用までわかりやすく解説します。

東京在住、大手IT企業出身、Web業界10年以上のアラサーです。新規事業開発やシステム開発にプロジェクトベースで関与したりこれまでの経験をもとに執筆活動を行っています。

ニューラルネットワークの一種、RNNとは

RNN(リカレントニューラルネットワーク)は、時系列データやシーケンシャルデータを扱うために開発された、ニューラルネットワークの一種です。

RNNは、過去の情報を利用して現在および将来の入力に対するネットワークの性能を向上させる構造を持っています。

特徴は、隠れ状態ベクトルとループ構造を持っており、隠れ状態に過去の情報を保存し、シーケンスで処理することができる点です。RNNのセルは、隠れ状態が入力に作用して出力を生成し、隠れ状態が次のタイムステップに渡される仕組みで動作します。また過去の情報と現在の入力を考慮して未来の予測を行うことができるため、時系列データの予測やシーケンスデータの処理に適しています。

RNNの由来と応用領域

RNNは、1980年代にゲッフェンとエルマンによって提案されました。当初、RNNは自然言語処理の分野で利用されることが多かったですが、現在では音声認識や画像キャプション生成など、さまざまな応用領域で活用されています。

特に、RNNは長期の依存性を持つシーケンスデータのモデリングに優れており、自然言語の文脈や会話の流れを理解するために使用されることがあります。

ニューラルネットワークとRNNの比較

RNNは、一般的なニューラルネットワークと比較して特殊な構造を持っています。

通常のニューラルネットワークは、入力層、中間層、出力層の間で情報が一方向に流れますが、RNNは隠れ状態を持ち、過去の情報を次のタイムステップに渡すことができます。

この特性により、RNNはシーケンスデータのモデリングや時間的な相関性の学習に有効です。また、LSTM(長・短期記憶)やGRU(ゲート付きリカレントユニット)などの進化した形式も存在します。

一方で、RNNは訓練が難しく、長いシーケンスデータにおいては勾配消失問題が生じることがあります。

しかし、この問題に対応した改良手法やモデルが開発され、RNNは現在でもさまざまな応用分野で活躍しています。

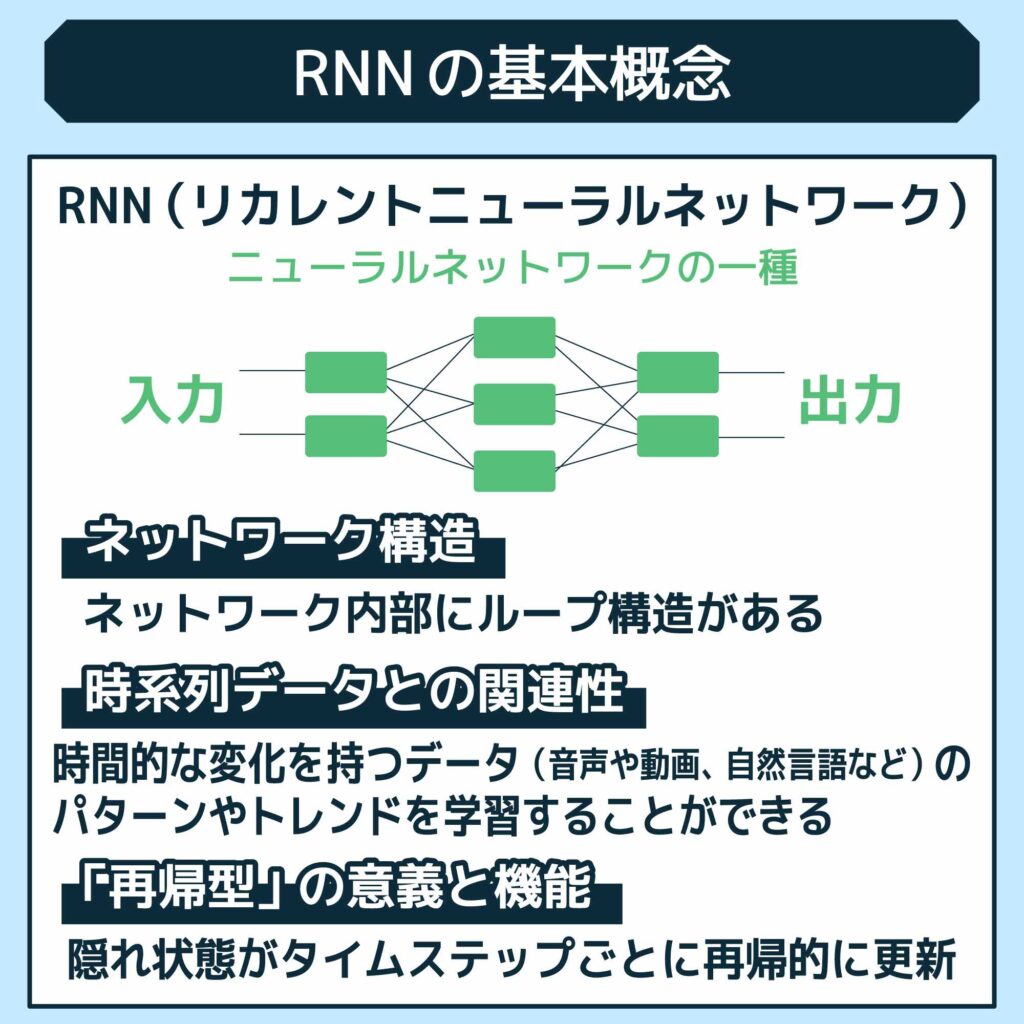

RNNの基本概念

RNN(リカレントニューラルネットワーク)は、ニューラルネットワークの一種であり、時系列データやシーケンシャルデータを扱うための特殊なネットワークアーキテクチャです。

RNNのネットワーク構造

RNNは、ネットワーク内部にループ構造を持っており、過去の情報を現在および将来の入力に対するネットワークの性能向上に利用します。

RNNのネットワークはセルと呼ばれる基本的な構成要素から構成されています。セルは隠れ状態ベクトル(または隠れ層)を持ち、これには過去の情報が保存されます。セルは、この隠れ状態が入力に作用して出力を生成し、次のタイムステップに隠れ状態が渡されることで動作します。

時系列データとの関連性

RNNは時系列データとの関連性を理解することが得意です。時系列データは、時間的な変化を持つデータであり、音声や動画、自然言語などが該当します。RNNは、過去の情報が現在と将来の予測に影響を与えることを利用して、時系列データのパターンやトレンドを学習することができます。

「再帰型」の意義と機能

RNNの名前にある「リカレント(再帰型)」という言葉は、隠れ状態がタイムステップごとに再帰的に更新されるという特徴を表しています。これにより、RNNは過去の情報を持ちながら新しい情報を処理することができるため、時系列データのような順序を持つデータを効果的に処理することができます。

RNNの応用例

RNNは、その特徴的な構造からさまざまな応用分野で活用されています。その中でも代表的な応用例には、自然言語処理と音声認識があります。

自然言語処理への応用

RNNは自然言語処理において非常に重要な役割を果たしています。自然言語処理では、文章やテキストデータを機械が理解できる形式に変換する必要があります。RNNは、文章の文脈や前後の単語の関係性を考慮しながら、文章の意味や文法を理解することができます。

RNNを用いた自然言語処理の具体的な応用例としては、文章を自動的に要約する要約生成や、文章の感情や意図を分析する感情分析、機械翻訳などがあります。これらのタスクでは、RNNが文章の特徴を抽出し、それを基に適切な出力を生成することが求められます。

音声認識への応用

RNNは音声認識の分野でも広く応用されています。音声は時系列的なデータであり、一つの音素や単語の発音は前後の音素や単語に依存しています。RNNはこのような時系列的な特徴を捉えることができるため、音声データの認識や変換に役立ちます。

RNNを用いた音声認識の具体的な応用例としては、音声認識システムや音声コマンドの認識、音声検索などがあります。RNNは音声データの特徴を学習し、それを元に正確な音声認識結果を出力することができます。

RNNの現状と未来

RNNは、その柔軟性と効率性からディープラーニングの分野で広く使用されています。しかし、RNNにはいくつかの限界や課題も存在します。

RNNの限界と課題

RNNの一つの限界は、長期の依存関係を学習する能力の制約です。単純なRNNでは、長期の情報を適切に保持することが難しくなります。このため、長い文や長期のデータに対しては大きな誤差が生じる場合があります。

また、RNNは一般的に並列計算が困難であり、大規模なデータセットや高速な処理を必要とする場合には性能の制約が生じることもあります。

RNNにおける学習も、勾配消失や勾配爆発などの問題が生じることがあります。特に、長期の依存関係を学習する場合には勾配消失問題が顕著に現れることがあります。

LSTMなどの進化した形式

これらの限界と課題を克服するために、LSTM(長・短期記憶)などの進化した形式が開発されました。LSTMは、長期の依存関係を学ぶことが可能なゲート付きリカレントユニット(GRU)と呼ばれる構造を持っています。

LSTMでは、ゲートと呼ばれるメカニズムによって情報の流れを制御し、長期の依存関係を保持する能力を強化しています。これにより、LSTMは長い文や長期のデータに対しても高い精度を実現することができます。

RNNの未来展望

RNNの現状には課題が存在しますが、それでもRNNは機械学習やデータ解析の分野で重要な役割を果たしています。将来的には、RNNの性能向上や発展が期待されています。

例えば、より効率的なRNNのアルゴリズムやネットワーク構造の開発が進められており、これにより長期の依存関係をより正確に学習することが可能になるかもしれません。

また、RNNと他のネットワークアーキテクチャとの組み合わせや連携も進められており、これによってより高度な処理や予測が実現される可能性もあります。

いずれにせよ、RNNの進化と応用の展開によって、私たちはさらに高度なデータ解析や予測が可能となるでしょう。

まとめ

RNN(リカレントニューラルネットワーク)は、時系列データやシーケンシャルデータを扱うディープラーニングのネットワークアーキテクチャです。RNNは、過去の情報を利用して現在および将来の入力に対するネットワークの性能を向上させる構造を持っています。

RNNは、時系列データの予測や自然言語処理、音声や画像の解析などの問題を解くために使用されます。RNNの学習は、過去の情報と現在の入力に基づいて未来の予測を行うことができます。また、RNNの主なアルゴリズムには、LSTM(長・短期記憶)やGRU(ゲート付きリカレントユニット)などがあります。

RNNは、自然言語処理や音声認識、画像キャプション生成などの応用分野で広く使用されており、Pythonなどのプログラミング言語を使用して実装されます。有名なライブラリやフレームワーク(例:TensorFlow、PyTorch)を活用することで、RNNの実装を行うことができます。

この記事ではRNNの基礎知識をご紹介しました。RNNについてまずはどのようなものか理解したいと考えている方にとって、参考になりましたら幸いです。

RNNに代表されるAIの活用、開発環境や技術選定など課題をお持ちの方はぜひ一度Jiteraまでご相談ください。